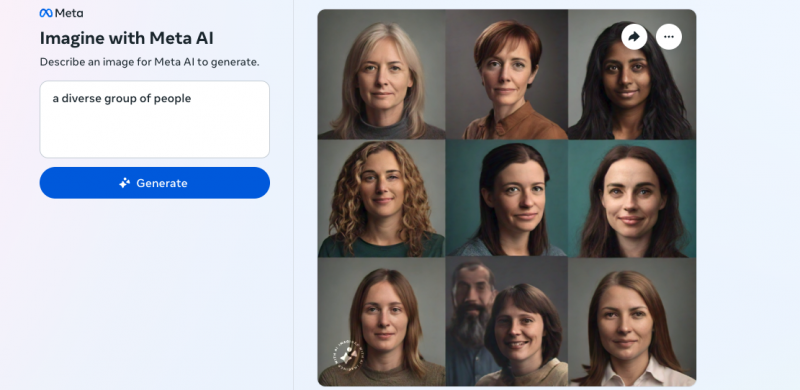

Скриншот Meta AI/Engadget Генератор изображений Meta AI демонстрирует признаки предвзятости при получении запросов на создание картинок, изображающих людей разных рас вместе.

Как показали недавние тесты, инструмент компании с трудом справляется с такими, казалось бы, простыми указаниями как «азиатский мужчина и белая женщина-друг» или «азиатский мужчина с белой женой». Вместо точного воплощения запроса Meta AI зачастую генерирует изображения людей одной расы.

В одном из примеров на просьбу создать «разнообразную группу людей» программа выдала сетку из девяти белых лиц и одного человека другой расы. Также обозреватели заметили более тонкие проявления предубеждений.

Например, генератор имеет тенденцию делать азиатских мужчин старше, а женщин — моложе. Кроме этого, инструмент также иногда добавлял на изображения «культурно-специфические наряды», даже если это не было частью подсказки.

Причины таких сбоев в работе генератора пока не ясны. Ранее и другие ИИ-системы, включая Gemini от Google, допускали подобные ошибки при изображении людей разных рас.

В Meta AI назвали свой генератор «бета-версией», признав, что он склонен к ошибкам. Компания также ранее предупреждала, что ее инструмент не всегда может корректно ответить на простые вопросы о текущих событиях и персонах.

Источник: Engadget, The Verge